Erpressung

in Appenzell

Der 18-Jährige nahm

einen Videoanruf entgegen. Kriminelle machten mit KI

ein Sexvideo draus

Künstliche Nacktbilder von Sekschülerinnen, falsche Videos der UNO-Botschafterin und eine Flut von KI-Kinderpornos: Die verheerenden Folgen der Deepfake-Technologie erreichen die Schweiz.

- Markus wurde Opfer einer neuen Art von KI-Sextortion mit täuschend echten Videos seiner Privatsphäre.

- KI-generierte Kinderpornografie nimmt derweil exponentiell zu und trifft nun auch Schweizer Schulen.

- Vor Gericht behaupten inzwischen Beschuldigte, belastende Beweise seien nur KI-generierte Fälschungen.

- Deepfakes sind bereits so gut, dass sie auch mit technischen Mitteln praktisch nicht mehr entlarvt werden können.

Es ist ein ruhiger Sonntagmittag im November letzten Jahres. Markus, ein 18-jähriger Schüler aus dem Kanton Appenzell Ausserrhoden, ist entspannt. Deswegen passt er eine Sekunde lang nicht auf und nimmt einen Videoanruf auf seinem iPhone an, ohne genau hinzuschauen. Was soll schon passieren?

Die Antwort erhält er Minuten später: Auf ihn wartet ein Albtraum.

Ab der Sekunde, als Markus abnimmt, sendet er in Echtzeit hochauflösende Videobilder an einen Unbekannten auf den Philippinen. Bilder aus seiner Privatsphäre: von seinem Körper, seinem Gesicht, seinem Bett und dem Poster mit einem Rapper an der Wand hinter sich. Wie gefährlich das ist, realisiert Markus in dem Moment nicht. Er versucht, mit dem Mann Englisch zu sprechen. Doch der hängt gleich wieder auf.

Dank verschiedener KI-Programme wie Sora, Grok oder Veo 3 lässt sich inzwischen innert Sekunden aus einer echten Videovorlage ein gefälschter Film erstellen – ein sogenannter Deepfake. Ist er gut gemacht, erkennen die meisten Menschen die Fälschung nicht.

Der Filipino hat das kurze Gespräch mit Markus aufgezeichnet, füttert den Film in ein KI-Programm und erstellt damit ein perfektes Deepfake-Video. Es sieht genauso aus wie das Original, doch jetzt zeigt es Markus nicht beim Sprechen – sondern beim Masturbieren.

Nur Minuten nach dem Anruf erhält Markus eine Whatsapp-Nachricht. Angehängt ist der Deepfake von ihm.

«Das Video hat brutal echt ausgesehen», erinnert sich Markus. Um ihn zu schützen, haben wir seinen Vornamen hier geändert. Nicht nur er selbst wurde perfekt gefakt. «Man sah auch meine Trainerhosen, mein schwarzes T-Shirt, mein Poster im Hintergrund … Ich selbst hätte die Fälschung nicht erkannt, wenn ich es nicht gewusst hätte. Jeder, der mich kennt, würde glauben, das sei echt. Ich war total schockiert.»

Drohungen mit Deepfakes über Whatsapp

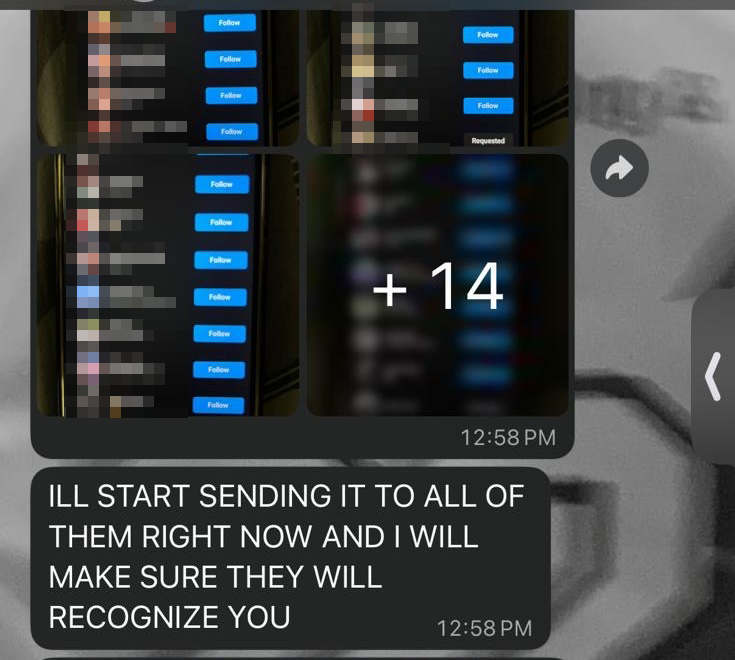

Doch das Video ist erst der Anfang. Sekunden nach der ersten Whatsapp-Nachricht kommt die nächste. Darin sind 14 Screenshots von all seinen Instagram-Kontakten. «Da waren selbst Leute, die ich kaum kenne, zum Beispiel die Freundinnen meiner Schwester», sagt Markus. Es sind insgesamt 150 Namen. Dazu schreibt der Erpresser eine Warnung in Grossbuchstaben: «ICH VERSENDE DAS VIDEO JETZT GLEICH AN ALLE. UND ICH WERDE SICHERSTELLEN, DASS SIE DICH ERKENNEN.»

In den nächsten 18 Minuten versucht der Erpresser, den 18-Jährigen mit immer drastischeren Drohungen zu zwingen, ihm 1000 Dollar via Western Union zu überweisen.

Zunächst schickt er einen weiteren Screenshot von seinem Handy. Darauf sieht man, dass der Mann bereits eine Nachricht an eine Bekannte von Markus vorbereitet hat. Darin kündigt er der jungen Frau ein «Skandalvideo» von Markus an, auf dem dieser «alt aussieht». Der Mann braucht jetzt nur noch «Senden» zu drücken, und sein Deepfake landet bei der Freundin. «Soll ich ihr das schicken oder löschen?», schreibt er.

Überfordert von KI-Sextortion

Danach versucht der Erpresser, Markus achtmal hintereinander anzurufen, und schickt ihm währenddessen über 30 Whatsapp-Nachrichten, teils im Sekundentakt. Er nennt ihn «Motherfucker» und droht, sein Leben zu ruinieren. Er übt maximalen Druck aus:

12.58: «Antworte mir», «Antworte mir schnell»

13.07: «Was ist jetzt?», «Das dauert mir zu lang»

13.11: «Zahlst du jetzt?»

13.13 «Push mich nicht bis zum Limit», «Ok, ich beginne jetzt, es ihnen zu schicken»

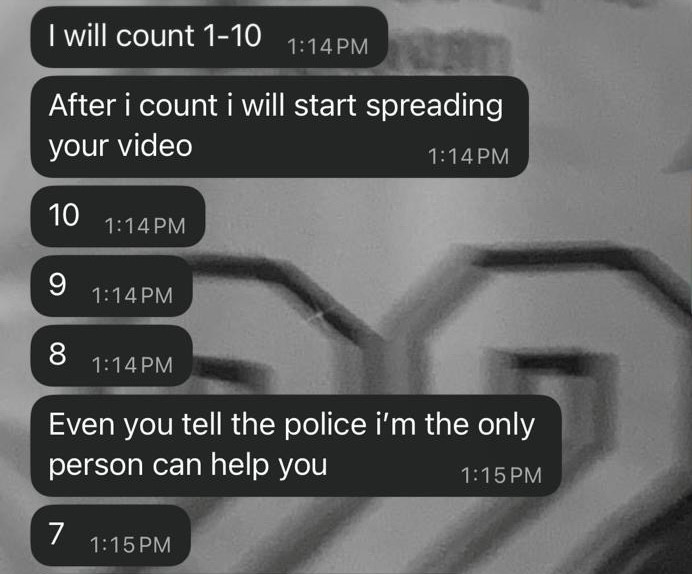

13.14: «Ich zähle jetzt von 10 runter», «10», «9», «8» …

«Ich war total überfordert», erinnert sich Markus. «Ich war fassungslos, was technisch bereits machbar ist.»

Markus ist Opfer einer sogenannten KI-Sextortion geworden. Kriminelle erpressen unbescholtene Menschen mit gefälschten KI-Sexbildern oder -videos. Betrüger setzen Deepfakes in der Schweiz aber auch im grossen Stil ein, um Geld von Firmen oder gutgläubigen Anlegern zu ergaunern – zum Beispiel mit falschen Videos von Prominenten wie Roger Federer oder Karin Keller Suter.

Die Deepfake-Technologie, der auch Markus zum Opfer fiel, verbreitete sich in den letzten Monaten rasend schnell. Dabei hinterlässt sie eine Spur der Verwüstung. Die Schäden, die diese Technologie anrichtet, steigen exponentiell – und nicht nur bei den Zigtausenden, die wegen Geld betrogen oder erpresst werden. Das zeigt sich bei drei weiteren Opfergruppen – auch in der Schweiz.

Kinderpornografie und KI

Gestern machte diese Redaktion einen Fall bekannt, bei dem Schüler einer Sekundarschule mittels KI Nacktbilder von zwei Mitschülerinnen erstellten – gegen deren Willen. Die Bilder teilten sie danach auf Snapchat. Sie nutzten dafür eine frei zugängliche Website, bei der selbst Jugendliche gratis kinderpornografische Bilder aus echten Vorlagen erstellen können. Inzwischen wurde der Fall an die Jugendanwaltschaft überwiesen.

In den USA und Spanien hatten solche Deepfakes teils traumatische Folgen für die betroffenen Schülerinnen. Sie sind strafrechtlich relevant, denn auch mit KI hergestellte sexualisierte Bilder von Kindern und Jugendlichen, die heimlich gemacht werden, gelten in der Schweiz als Kinderpornografie und sind strafbar.

In ihrer neuesten Studie schreibt die renommierte britische NGO Internet Watch Foundation, sie habe letztes Jahr insgesamt 3440 KI-Videos mit sexuellem Kindesmissbrauch gefunden. Im Jahr davor waren es erst 13 gewesen. Die Zahl von fotorealistischen KI-Bildern und -Videos sei auf ein «gefährliches Niveau» gestiegen. Zwei Drittel des Materials sei inzwischen von der extremsten Kategorie. «Ohne sofortige Massnahmen werden KI-Tools zu ‹Maschinen für sexuellen Kindesmissbrauch›», schreibt die NGO.

Eingedämmt wird das Problem bislang nicht, wie der Skandal rund um das KI-Modell Grok von Elon Musk zeigt. Spezialisten der Firma AI Forensics sammelten zwischen dem 25. Dezember 2025 und dem 1. Januar 2026 eine zufällige Probe von öffentlichen KI-Bildern, die Nutzer mit Grok hergestellt hatten. Darin fanden sich 30 generierte Bilder von teils sehr jungen Mädchen in «minimaler Bekleidung, meistens in Bikini oder durchsichtigen Kleidern», schreibt AI Forensics in seinem Bericht. «Einige der generierten Bilder zeigten Kinder unter 5 Jahren.»

Inzwischen bestätigte die Firma von Musk einige Fälle auf X: «Ein Nutzer schickte ein Foto von zwei jungen Mädchen (12 und 16) und beauftragte Grok, sie in sexy Unterwäsche von hinten zu zeigen.» Zu den Opfern gehörte auch die 14-jährige Schauspielerin Nell Fisher, bekannt aus der Netflix-Serie «Stranger Things».

Das Problem trifft auch die Schweiz. «KI-generierter, pädopornografischer Inhalt stellt die Polizei vor grosse Herausforderungen», schreibt das Bundesamt für Polizei in einem Bericht. «Die Menge des Materials nimmt seit Jahren exponentiell zu, doch der Aufwand, zwischen echten und KI-generierten Bildern zu unterscheiden, wird immer komplexer und grösser.» Nachdem die Polizei in Dänemark über 30’000 KI-generierte, kinderpornografische Bilder beschlagnahmt hatte, fanden sich auch drei mutmassliche Käufer in der Schweiz. Nach Hausdurchsuchungen in Basel-Landschaft, Luzern und Zürich wurden sie letztes Jahr festgenommen.

Deepfakes in der Politik

Im Mai 2023 präsidierte Pascale Baeriswyl als Vertreterin der Schweiz den UNO-Sicherheitsrat und war damit im Fokus einer breiten Öffentlichkeit rund um die Welt. Was bis heute kaum bekannt ist: Schon damals wurde sie Opfer eines politischen Deepfakes.

Während der Präsidentschaft Baeriswyls zirkulierte in den sozialen Medien ein Video, das vermutlich von Akteuren der Krise in Haiti geteilt wurde. Das Video zeigte Bilder von Baeriswyl, dazu ist eine Rede auf Französisch zu hören, die sie gehalten haben soll. Parallel ist eine englische Simultanübersetzung zu hören, wie sie üblich ist bei der UNO.

Beide Stimmen waren Fälschungen. Anders als bei heutigen Deepfakes haben die Fälscher es damals aber noch nicht geschafft, die Stimme der Botschafterin gut zu imitieren.

Das Video wollte aber den Anschein erwecken, dass es sich um eine offizielle Äusserung der Präsidentin des UN-Sicherheitsrats handelt. Haiti steht seit längerem unter UNO-Sanktionen. Auf dem Fake-Video äusserte sich Baeriswyl kritisch gegenüber den Sanktionen gegen Haiti, was sie in Wahrheit nicht getan hatte. Die Fälschung diente offensichtlich den dortigen politischen und wirtschaftlichen Interessen.

Seit dem Vorfall fanden Deepfakes auch Einzug in die Schweizer Politik. Letzten Juni hoben National- und Ständerat die Immunität von SVP-Nationalrat Andreas Glarner auf, weil er einen Deepfake von Aussenpolitikerin Sibel Arslan geteilt hatte. Glarner liess die Basler Grüne-Politikerin sagen: «Ich will, dass alle kriminellen Türken ausgeschafft werden.» Inzwischen nutzen auch linke Kreise Deepfakes von Politikern.

2023 gründeten über 250 weltweit führende Forscher in Zürich das International Panel on the Information Environment. Seither liefert die Organisation regelmässig vertiefte Berichte über globale Angriffe auf die Informationssicherheit. 2025 veröffentlichten die Experten die bislang wohl umfassendste Studie zum Thema KI-Einsatz bei Wahlen weltweit.

Das Resultat: In 80 Prozent der Staaten, die 2024 Wahlen abhielten, kam es zu Zwischenfällen mit KI-Inhalten. «Es ging darum, Wähler zu beeinflussen, Falschinformationen zu verbreiten und demokratische Prozesse zu stören», heisst es in der Studie. Die Auswirkungen dieser Technik seien nicht mehr spekulativ. «Sie sind beobachtbar und global.» Und die Angriffe haben Erfolg.

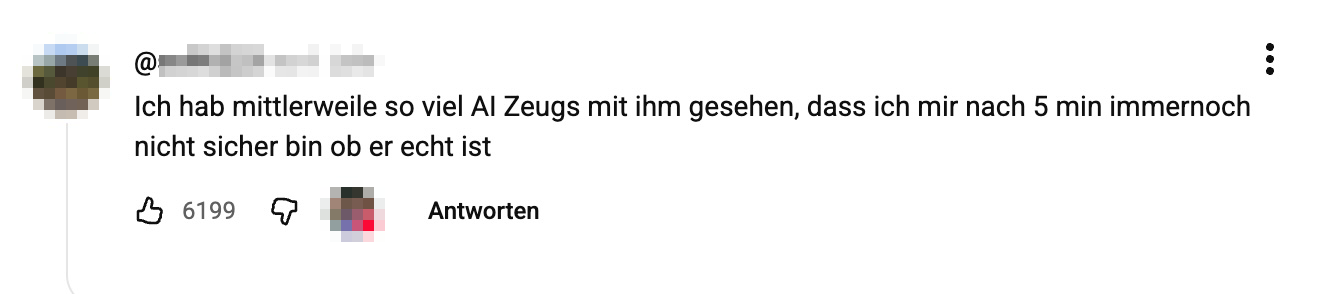

In Rumänien, der Slowakei und sogar im Vatikan brachten Deepfake-Kampagnen die staatlichen Institutionen an den Abgrund. In der Türkei musste ein Gegenkandidat von Staatspräsident Recep Tayyip Erdogan in einer Wahl wegen eines pornografischen Deepfakes sogar zurücktreten. Das Resultat: Bei Videos von Politikerinnen und Politikern auf Youtube äussern sich immer mehr Nutzer, die nicht mehr wissen, ob sie echt sind.

Auch die Schweiz ist nicht gefeit vor Fakes. Letzten Dezember erklärte das Staatssekretariat für Sicherheitspolitik beim Bund, dass die Schweiz 2025 im Visier einer Kampagne stand, die über sieben Social-Media-Plattformen lief. Darin wurde behauptet, die Schweiz versinke im Chaos. Dazu dienten Bilder von echten Auseinandersetzungen, die aber in anderem Kontext stattfanden. Die Kampagne – mutmasslich von Russland orchestriert – generierte über zwei Millionen Klicks.

Deepfakes beschäftigen die Justiz

Ein weiterer Effekt von Deepfakes beginnt sich erst langsam abzuzeichnen. Im Fachjargon nennt man ihn «die Dividende der Lügner». Gemeint sind die unerwarteten Vorteile für alle, die von echten Audioaufnahmen, Bildern oder Videos überführt werden. Sie haben nun dank KI die Möglichkeit, zu behaupten, das Beweismaterial sei nur ein Deepfake.

«Wir begegnen vermehrt Beschuldigten, die behaupten, ein Überwachungsvideo oder ein Handyfilmchen sei schlicht ein Fake», sagt Cordula Lötscher, Professorin für Privatrecht an der Universität Basel und nebenamtliche Richterin am Bundesgericht.

Früher habe man Videos einer Überwachungskamera, ein Handyfilmchen oder einen Whatsapp-Verlauf als zuverlässige Beweismittel gesehen. «Doch jetzt haben wir Beschuldigte, die sagen, dieses Video oder dieses Bild sieht zwar so aus wie ich, aber ich bin das nicht – und wir müssen damit umgehen, dass gute Fälschungen realistisch geworden sind.»

Dieses Phänomen ist neu. «Früher gab es weniger Möglichkeiten, solche Beweismittel überhaupt in guter Qualität zu fälschen», sagt die Richterin. «Heute muss man nicht mehr viel können, um ein Fake-Video oder Fake-Audios in täuschend echter Qualität herzustellen.»

Zwar reicht es vor Gericht nicht, einfach zu behaupten, ein Beweis sei gefälscht. Aber allein die technischen Möglichkeiten sorgen bei den Staatsanwaltschaften und den Gerichten für mehr Arbeit bei der Verifikation von Beweisen. «Und diese Probleme werden möglicherweise drastisch zunehmen», befürchtet Lötscher.

In den USA wurden solche Lügen schon mehrfach öffentlich. Elon Musk versicherte vor Gericht, ein Beweisvideo von ihm sei gefälscht. Die Richterin wies das ab. Auch Beteiligte am Sturm auf das US-Capitol 2021 erklärten vor Gericht, die Videobeweise gegen sie seien Deepfakes. Sie wurden zwar trotzdem verurteilt, aber später von Donald Trump wieder begnadigt. Der Präsident selbst bezeichnete echte Videos von den grossen Zuschauermengen seiner Rivalin Kamala Harris als Fakes.

Wie reagierte das Opfer Markus?

In allen vier Bereichen – Sextortion, Kinderpornos, Politik und Justiz – sind sich Experten einig, dass die schlimmsten Auswirkungen der Deepfake-Technologien erst bevorstehen. In seinem neuen globalen Risiko-Report vom Januar 2026 schreibt das World Economic Forum: «Innerhalb eines Jahrzehnts können Deepfakes allgegenwärtig werden. Für die Bürger wird es dann unmöglich, Wahrheit von Täuschung zu unterscheiden.»

«Es wird wohl in Zukunft auch mit technischen Mitteln nicht mehr möglich sein, zumindest mit Standardverfahren, die Deepfakes noch zu erkennen – sie werden einfach zu gut», sagt Peter Eisert, Professor für Visual Computing an der Berliner Humboldt-Universität. Er hat Methoden studiert, mit denen sich Deepfakes entlarven lassen.

Spezialisierte Programme können zum Beispiel in einem echten Video den Pulsschlag eines Menschen in dessen Gesicht ablesen. Computer scannen dafür die für Menschen unsichtbaren Farbveränderungen der Pixel im Gesicht. «Jetzt mussten wir feststellen, dass moderne KI-Modelle diesen Herzschlag im Gesicht auch in ihre Deepfakes bauen», sagt Eisert. Mit anderen Worten: Die neuesten Deepfakes imitieren selbst den menschlichen Puls.

Von alledem wusste der Appenzeller Schüler Markus wenig, als er an jenem Sonntag seinen eigenen Deepfake erhielt – und vor einem Abgrund stand. Dennoch macht sein Fall Hoffnung, dass man mit Mut und gesundem Menschenverstand auch gegen die schlimmste Desinformation ankommen kann.

«Zuerst war ich überfordert», erinnert sich der 18-Jährige. «Ich habe mir überlegt, wie ich das Geld beschaffen könnte. Ich wusste einfach nicht, was ich machen soll.» Doch dann habe er sich beruhigt und nachgedacht. «Ich dachte mir, wenn er das Video tatsächlich abschickt, wird er kein Geld mehr erhalten.»

Rat von der KI gegen KI-Sextortion

Markus ignorierte also die ganzen Beschimpfungen und Druckversuche mit Countdowns und Screenshots und verfasste derweil eine eigene Nachricht auf seinem Instagram-Profil, in der er vor dem Deepfake warnte.

Danach blockierte er den Filipino und meldete ihn auf Instagram. Schon am nächsten Abend wurde der Erpresser blockiert. «Aber an diesem Sonntag war ich den ganzen Tag sehr gestresst», erinnert sich Markus. Er hat auch danach tagelang schlecht geschlafen. «Ich wusste ja nicht, ob das Video doch noch kommt», erklärt er. Er hat gesurft und recherchiert, was in solchen Fällen üblicherweise passiert. Sogar Chat-GPT hat er gefragt. Die KI sollte ihm helfen, den Schaden von KI zu lindern.

So fand er schnell heraus, dass die Videos in den meisten Fällen von Sextortion nicht veröffentlicht werden. Und so war es letztlich auch in seinem Fall. Der Mann auf den Philippinen hat es bis heute nicht an Markus’ Freunde verschickt.

«Man sollte seine Umgebung warnen und auf keinen Fall bezahlen», sagt Markus. «Wenn du Geld schickst, hören sie nicht auf, sondern verlangen immer mehr, weil sie wissen, dass du jemand bist, der bezahlt. Ich finde es wichtig, dass alle das wissen. Gegen diese Deepfakes hilft nur eines: Aufklärung.»

Haben Sie einen vertraulichen Tipp für uns? Verfügen Sie über Informationen oder Dokumente, die an die Öffentlichkeit gehören? Es gibt verschiedene Mittel und Wege, um sicher und anonym mit unseren Journalistinnen und Journalisten Kontakt aufzunehmen. Hier zeigen wir Ihnen, wie.